基本構想

日本政府は令和7年12月23日に「信頼できるAI」による「日本再起」を掲げた人工知能基本計画(AI基本計画)を閣議決定しました。この計画は「世界で最もAIを開発・活用しやすい国」を目指すものです。

現在、日本はAI分野で出遅れており、日常生活や仕事でのAI利活用が進んでいません。人手不足など社会課題が山積する日本こそ、積極的にAIを活用すべき状況にあります。しかし、投資規模では出遅れた日本が、極めて広範な産業基盤と「信頼性」という価値を活かして「反転攻勢」に出る好機が今訪れています。

3つの基本原則

- イノベーション促進とリスク対応の両立

- アジャイルな対応(PDCAサイクルの循環)

- 内外一体での政策推進(国内政策と対外政策の有機的結合)

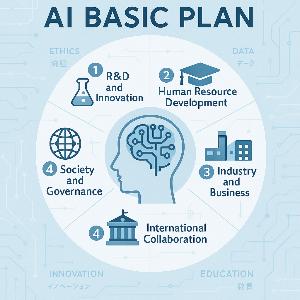

4つの基本方針と具体的施策

第1節:AI利活用の加速的推進(「AIを使う」)

政府自らが率先してAIを利活用し、社会全体での活用を促進します。

主な取組:

- ガバメントAIの推進により、速やかに本府省庁職員が生成AIを利活用できる環境を構築

- 指定職・管理職による率先した利活用を促す仕組みの導入

- 地方自治体における優良ユースケースの横展開

- 医療・ヘルスケア、介護、金融、教育、防災、農林水産業、製造業、インフラ、物流などでのAI導入促進

- 中小企業向けのデジタル化・AI導入補助金の活用

- 防衛力強化や警察活動の高度化へのAI利活用

- データ連携基盤の構築(医療、教育、農林水産業、建設などの準公共分野)

具体例:

- AI北海道会議などの実証・導入推進の取組

- STATION Aiなどスタートアップ支援施設の整備

第2節:AI開発力の戦略的強化(「AIを創る」)

日本独自のAI研究開発能力を強化し、「信頼できるAI」を開発します。

主な取組:

- マルチモーダルなデータの創出・提供

- 国内外からのトップ人材確保(待遇面や生活環境の向上)

- AIモデルの高性能化・マルチモーダル化

- 評価基盤やテストベッドの整備

- フィジカルAI(AIロボット、自動運転技術)の研究開発

- AI for Science(ライフサイエンス・マテリアル分野での基盤モデル開発)

- 創薬AIの推進

- 日本語データの整備・拡充

- オープンソース・オープンウェイトのAIモデル開発

- データセンター整備、AI半導体開発、次世代通信基盤(Beyond 5G)の研究開発

- スーパーコンピュータ「富岳」の次世代システム開発

第3節:AIガバナンスの主導(「AIの信頼性を高める」)

信頼できるAIエコシステムを構築するため、適正性確保のPDCAサイクルを構築します。

主な取組:

- AIセーフティ・インスティテュート(AISI)の抜本的強化(人員を直ちに現行の2倍程度に拡充)

- ディープフェイクなどAI悪用問題への対応

- AI法第13条に基づく指針やガイドラインの整備

- AIを悪用したサイバー攻撃や詐欺への対応

- AI生成コンテンツを判別する技術開発(電子透かしなど)

- 広島AIプロセスフレンズグループの活用

- ISO/IEC JTC1におけるAI国際標準化活動への参画

- GPAIデータセンターの活用

- グローバルサウス諸国との共創・協力モデル構築

ベンチマーク: 英国AI Security Institute(約200名以上、初期予算約200億円)を参考に体制強化

第4節:AI社会に向けた継続的変革(「AIと協働する」)

人とAIが協働する社会を実現するため、産業構造や教育を変革します。

主な取組:

産業構造の構築:

- AIトランスフォーメーション(AX)の促進

- 地域におけるAIインフラを活用した産業創出

- 規制のサンドボックス制度の活用

- 「AI経済圏」の展開調査

制度・枠組みの検討:

- AI利活用における民事責任の在り方検討

- 知的財産の保護と利活用(コンテンツホルダーへの対価還元)

- 雇用への影響調査(代替性と補完性の両面)

AI人材の育成:

- エンジニア、研究者、データマネジメント人材の育成

- 個々の従業員へのAIリ・スキリング支援

- アドバンスト・エッセンシャルワーカーの創出

- デジタルスキル標準の改訂

- 初等中等教育段階での情報活用能力向上

- リベラルアーツ教育を含むAI時代の教育推進

人間力の向上:

- 創造力、思考力、判断力、適応力、コミュニケーション力の育成

- AIと共に課題を解決できる人材育成

主要なリスクへの対応

計画では以下のようなAIのリスクを認識し、対応を図っています:

- 技術的リスク:誤判断、ハルシネーション、不適切な情報出力

- 社会的リスク:差別・偏見の助長、犯罪利用、プライバシー侵害、著作権侵害、偽情報拡散、雇用不安

- 安全保障リスク:サイバー攻撃

推進体制

| 組織 | 役割 |

|---|---|

| 人工知能戦略本部 | 内閣総理大臣が本部長、全閣僚が構成員。基本計画の推進状況把握とフォローアップ |

| 人工知能戦略推進会議 | 関係府省庁が構成員。緊密な連携実施 |

| 人工知能戦略専門調査会 | 有識者等の意見聴取 |

計画は毎年見直しを行い、技術動向や社会情勢を反映させていきます。また、科学技術・イノベーション基本計画やデジタル社会形成重点計画など、他の関連計画との連携・整合を図ります。